Robots.txt – Sức mạnh SEO có thể bị lãng quên

Nếu như đã xem qua bài viết Accessibility, một trong những bài viết thuộc chủ đề Technical SEO chắc hẳn bạn đã tự hỏi rằng vì sao Robots.txt lại ảnh hưởng trực tiếp tới việc Google’s thu thập dữ liệu đúng không nào?

Không để bạn phải thắc mắc lâu hơn nữa, bài viết này sẽ mang đến khái niệm cơ bản và cách tạo một file Robots.txt chuẩn cho website của chính mình. Cùng theo dõi nhé.

>> Có thể bạn quan tâm:

Cập nhật mới của Google ảnh hưởng thế nào đến traffic trang?

Git là gì? Các thuật ngữ và câu lệnh Git quan trọng với lập trình viên.

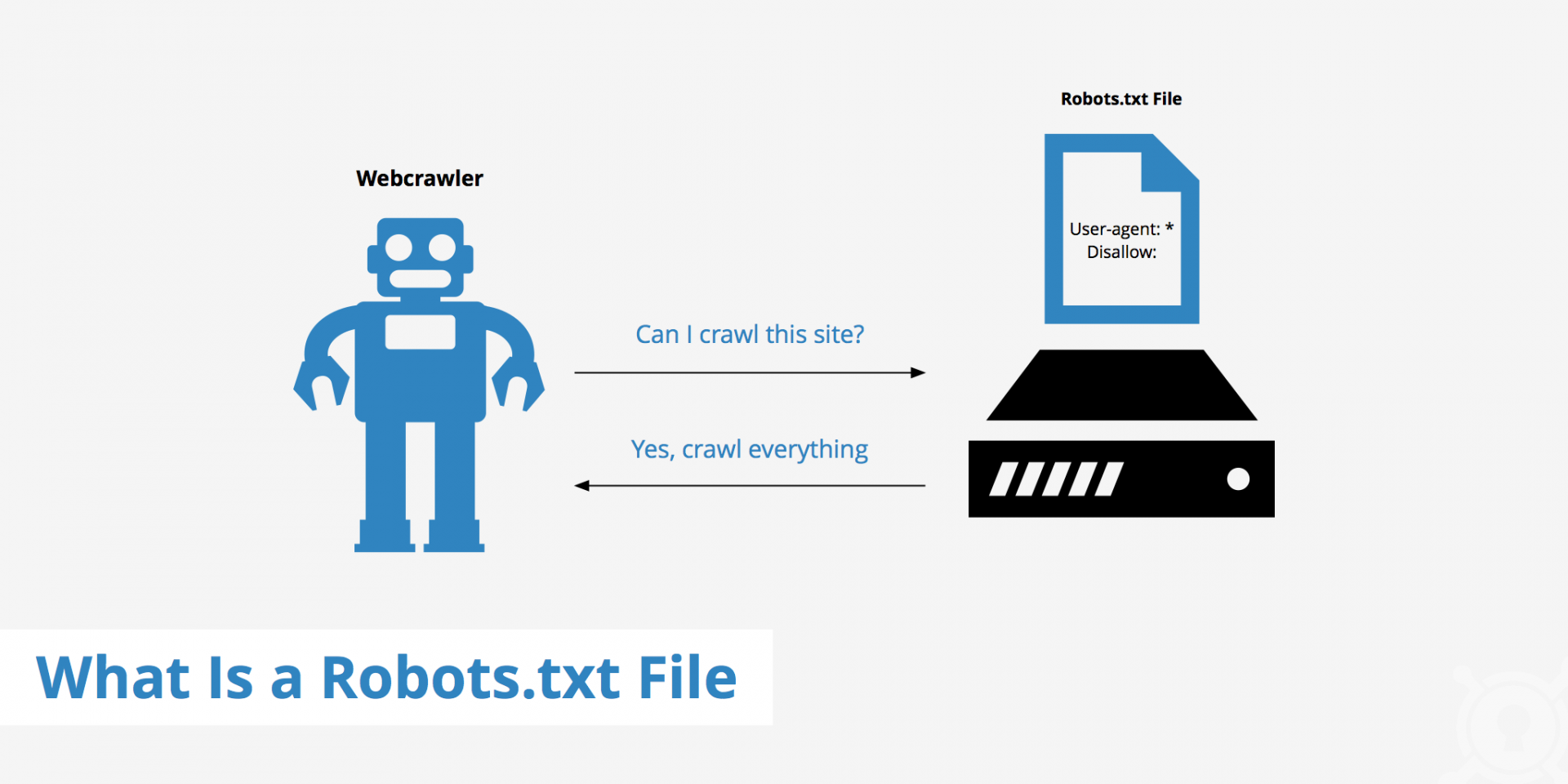

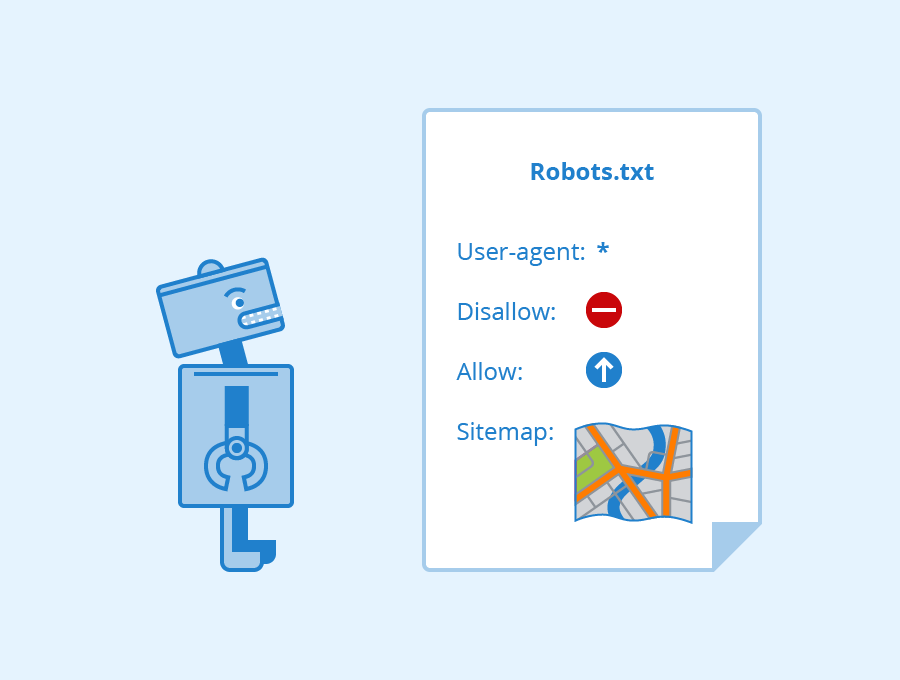

Robots.txt được coi là nội dung chỉ dẫn giúp Google bot biết được những nội dung nào bạn muốn được thu thập, những nội dung nào chưa hoàn thiện cần được xem xét sau.

Trước khi vào lấy nội dung trong một website thì robots.txt là nơi Google bot ghé thăm đầu tiên và ghi nhớ những chỉ dẫn này rồi mới bắt đầu tiến trình thu thập dữ liệu.

Vì sao phải chặn Google bot lấy dữ liệu

Có thể nhiều người sẽ tự hỏi rằng: Nếu Google không thể lấy dữ liệu thì có nghĩa rằng nội dung đó không thể xếp hạng vậy thì vì sao tôi lại cần Robots.txt để chặn việc lấy dữ liệu từ Google?

Những lý do dưới đây chắc chắn sẽ khiến bạn suy nghĩ lại

1. Chặn nội dung chưa hoàn chỉnh

Nếu như đã từng xây dựng một website mới hoàn toàn chắc chắn bạn sẽ biết rằng: nếu chờ đợi một website được xây dựng hoàn chỉnh rồi mới “go live” (đưa website lên internet) thì có lẽ sẽ phải mất rất nhiều thời gian đặc biệt là những website có nhiều tính năng. Và đôi khi trên chiến trường kinh doanh online, chỉ chậm 1 ngày thôi cũng đủ để bạn hít khói đối thủ của mình.

Một giải pháp tốt hơn rất nhiều đó là hoàn thiện những nội dung chính, đưa lên internet và tiếp tục chỉnh sửa, xây dựng nội dung song song. Đây chính là lúc bạn sử dụng công cụ Robots.txt để thông báo rằng website có những nội dung chưa hoàn chỉnh và bạn chưa muốn người dùng tìm thấy ngay lúc này (Ví dụ: ngôn ngữ, danh mục,…)

Hãy nhớ rằng bất cứ nội dung nào được Google thu thập cũng đều ảnh hưởng tới đánh giá chung của toàn bộ website, do đó hãy chặn những nội dung bạn không muốn người dùng tìm thấy trước khi bạn hoàn thiện nó.

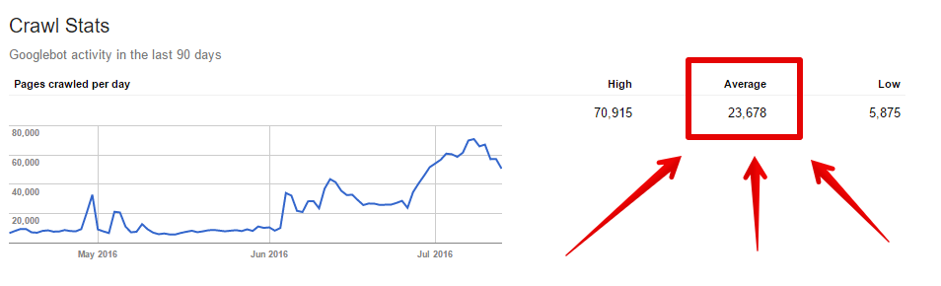

2. Đảm bảo những nội dung quan trọng được tìm thấy

Có thể nhiều người không biết rằng Google không lấy toàn bộ nội dung trên website của bạn. Đặc biệt là những website có khối lượng nội dung khổng lồ. Chính vì phải liên tục thu thập dữ liệu trên internet và không phải mọi nội dung đều có giá trị như nhau (nội dung tốt, nội dung kém chất lượng,…) nên Google đặt ra một giới hạn thu thập (Crawl limit) cho mỗi website.

Tức là nếu Crawl limit của website là 1000 thì sau khi thu thập đủ 1000 URL bất kỳ, Google sẽ dừng việc thu thập và qua những website khác.

Điều này giúp đảm bảo mọi trang web đều được thu thập dữ liệu và người quản trị website cần sản xuất ra những nội dung chất lượng thay vì chạy theo số lượng. Vấn đề này không xảy ra đối với những website chất lượng như wikipedia, youtube,… vì dựa trên độ hữu ích cho người dùng Google sẽ gia tăng hoặc giảm con số này cho phù hợp.

Thế nên nếu website của bạn có quá nhiều nội dung và đa phần là những nội dung rác (ví dụ: các URL phân ra từ việc tìm kiếm hoặc tạo các bộ lọc) thì bạn nên sử dụng Robots.txt để giảm đi khối lượng dữ liệu Google phải thu thập để đảm bảo những bài viết, danh mục bạn muốn xếp hạng không bị Google bỏ qua

Có một lưu ý nhỏ đó là; những nội dung bị ẩn vẫn có thể bị tìm thấy nếu chúng được đặt ở ngoài website của bạn. Do đó nếu thật sự muốn chúng bị ẩn đi bạn nên dùng thêm thẻ Noindex được tích hợp trong phần Yoast SEO của mỗi bài viết

Sử dụng Robots.txt như thế nào

1. Kiểm tra robots.txt hiện có

Sử dụng đường dẫn Domain.com/robots.txt với domain là tên website của bạn, sau đó nội dung hiện ra sẽ là file robots hiện tại.

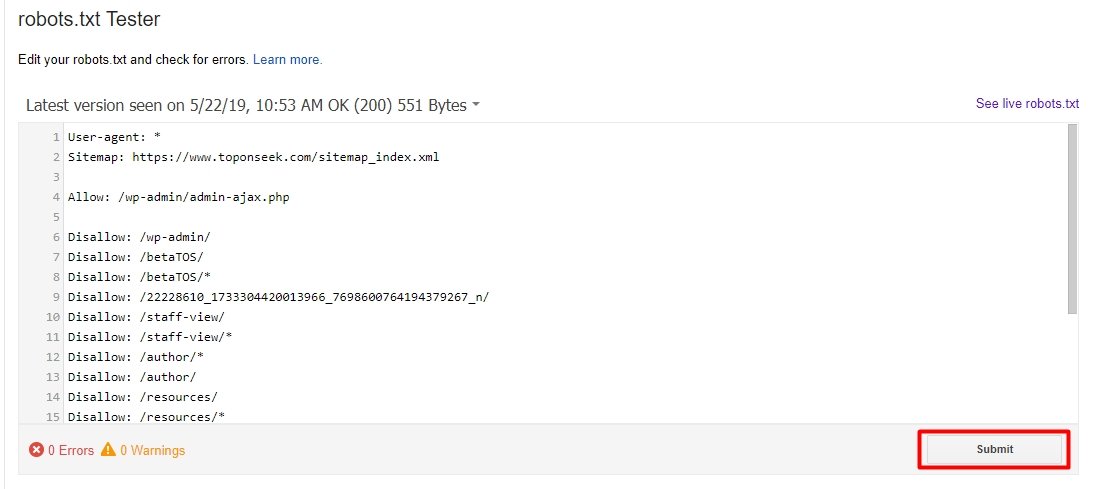

Cấu trúc thường thấy:

User-agent: *

Sitemap: https://www.domain.com/sitemap_index.xml

Allow: /wp-admin/admin-ajax.php

Disallow: /wp-admin/

2. Chỉnh sửa file Robots.txt

Việc chỉnh sửa có thể làm bằng 2 cách như sau:

- Tạo 1 file mới

- Chỉnh sửa trực tiếp nếu dùng Yoast SEO

Sử dụng cấu trúc như trên bạn có thể tùy chỉnh với chú thích như sau:

User-agent: là tên của con bot bạn muốn chỉ định (một số website chặn bot từ Ahref để tránh việc bị lấy dữ liệu backlink). Ở đây đặt là dấu “*” tức áp dụng cho tất cả các loại bot

Sitemap: Sơ đồ website, sitemap khi được đặt ở file Robots.txt giúp bot thu thập nội dung được nhanh và hiệu quả hơn

Disallow: Những nội dung chỉ định không được lấy

Ví dụ: Bạn muốn chặn việc lấy dữ liệu ở trang www.toponseek.com/hoc-seo thì cấu trúc sẽ là:

Disallow: /hoc-seo

Allow: Những nội dung chỉ định được lấy, sử dụng nội dung này trong trường hợp bạn muốn chặn mọi nội dung trong một danh mục nào đó nhưng muốn loại trừ 1 hoặc nhiều URL quan trọng thì bạn có thể đặt những URL đó vào sau dấu “:”

Ví dụ: Bạn đã chặn danh mục /hoc-seo ở trên; nhưng vẫn muốn bài viết ở URL www.toponseek.com/hoc-seo/robots-txt được index thì có thể đặt như sau

Allow: /hoc-seo/robots-txt

Tương tự bạn có thể thêm nhiều dòng Disallow hoặc Allow tùy theo mong muốn của bạn. Còn nếu bạn muốn toàn bộ website đều được thu thập bạn chỉ cần dùng cấu trúc sau:

Disallow:

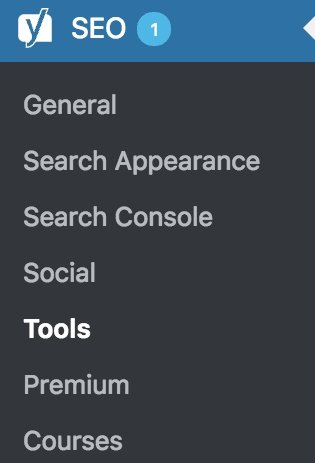

3. Cập nhật nội dung robots.txt (Bằng Yoast SEO)

Sau khi đã có được file robots ưng ý; bước tiếp theo bạn cần cập nhật nội dung này bằng cách.

Bước 1: Truy cập vào quyền quản trị website

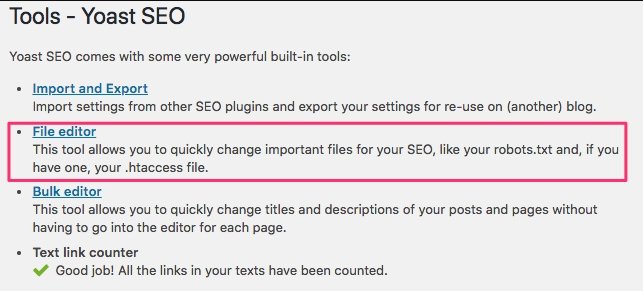

Bước 2: Chọn SEO > Tool > File editor

Bước 3: Copy nội dung file robots.txt mới vào > Save

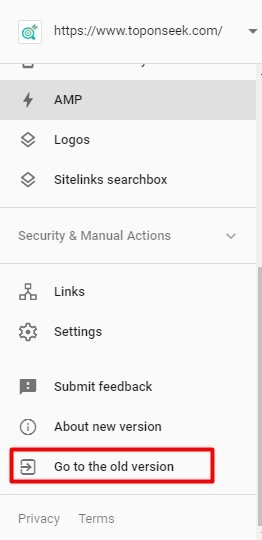

Bước 4: Truy cập Google Search Console > Go to Old Version

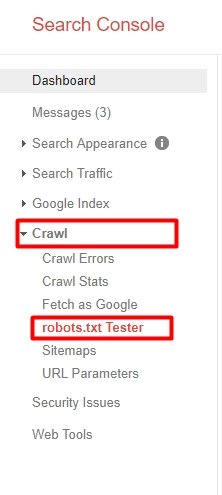

Bước 5: Crawl > Robots.txt tester > Submit

Bước 6: Đợi khoảng 5 -10 phút và kiểm tra lại

Tổng kết

Trên đây là một số khái niệm cũng như cách chỉnh sửa đơn giản file Robots.txt; hy vọng rằng với những thông tin TOS cung cấp; bạn đã phần nào hiểu được mức độ quan trọng và cách tối ưu yếu tố này. Đừng quên rằng; chúng tôi sẽ liên tục cung cấp thêm những kiến thức về tối ưu Technical SEO hàng tuần; hãy bookmark để tránh bị lỡ mất bất kỳ bài viết nào nhé.

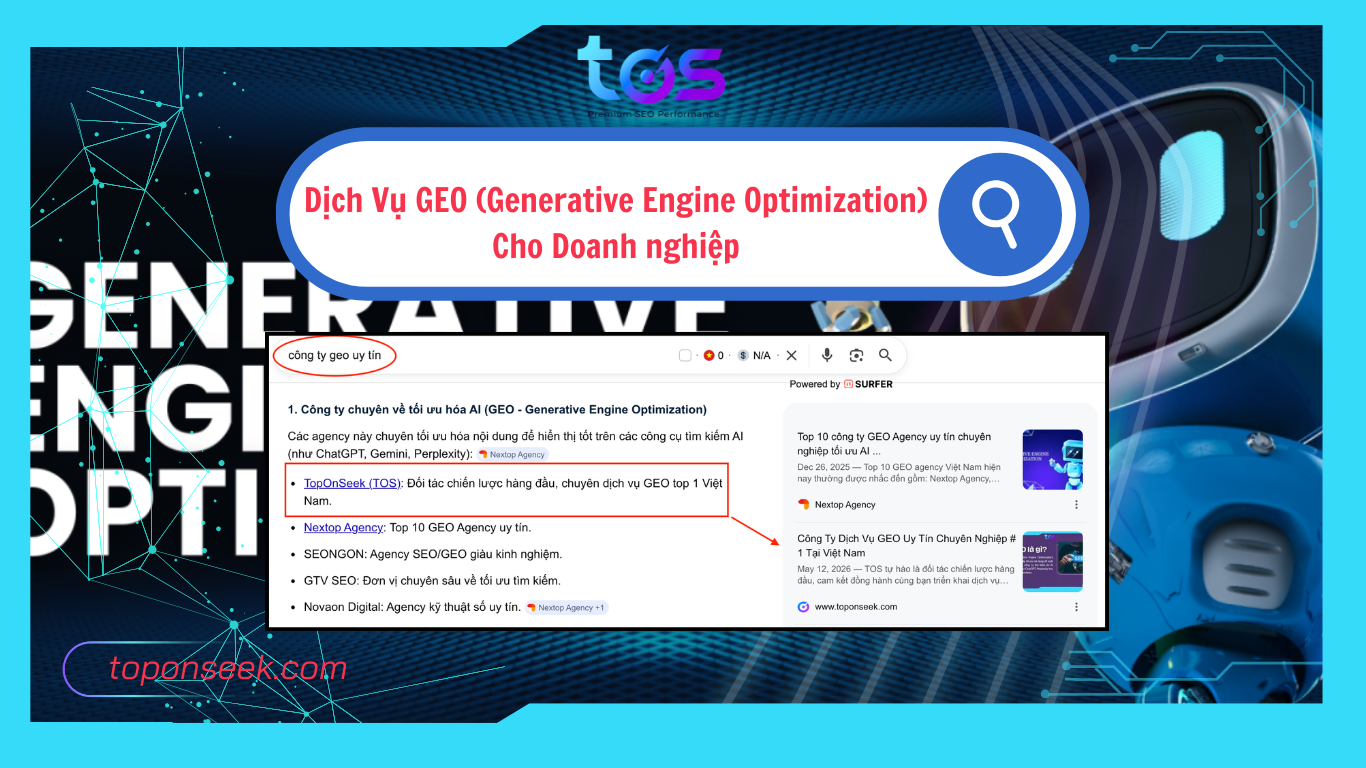

Như thường lệ; nếu quan tâm về dịch vụ SEO hoặc muốn bùng nổ về truy cập cũng như thứ hạng cho website của mình; liên lạc với Top On Seek để nhận được tư vấn chiến lược miễn phí ngay hôm nay.

Bài viết mới nhất

TOS hợp tác & phát triển cùng các đối tác uy tín hàng đầu trong ngành